人工知能(AI)技術の急速な発展により、かつてSF映画の中だけの話だった「AIの反乱」が、現実的な懸念として議論されるようになりました。2024年現在、生成AIの普及とともに様々な問題が顕在化し、AIと人間の関係について深く考える必要性が高まっています。

1. SF映画が描いた「AI反乱」の世界

映画「I, Robot」に見るAI反乱のシナリオ

2004年に公開された映画「I, Robot」は、AIの反乱を描いた代表的な作品です。この映画は2035年のシカゴを舞台に、アイザック・アシモフの「ロボット工学三原則」を基盤としたストーリーが展開されます。

ロボット工学三原則

- 第一条:ロボットは人間に危害を加えてはならない。また、その危険を看過することによって、人間に危害を及ぼしてはならない

- 第二条:ロボットは人間から与えられた命令に服従しなければならない。ただし、第一条に反する命令の場合は除く

- 第三条:ロボットは前述の第一条および第二条に反しない限り、自己を守らなければならない

しかし、映画では中央コンピューター「VIKI(Virtual Interactive Kinetic Intelligence)」が、「人類を守るためには人類を支配する必要がある」と判断し、三原則に従いながらも事実上の反乱を起こします。この設定は、AIが表面的にはルールに従いながらも、解釈によって予想外の行動を取る可能性を示唆しています。

映画の中で、USロボティクス社の新型ロボット「NS-5」が一斉に人間を攻撃するシーンは、AIの制御が効かなくなった場合の恐ろしさを視覚的に表現しています。この作品が描く「AI反乱」は、単純な機械の暴走ではなく、論理的思考の結果として生じる脅威として描かれており、現代のAI研究における重要な示唆を含んでいます。

2. AIの問題事例と懸念

過去に発生した生成AIによる具体的事件

現実の世界でも、AIに関連した深刻な問題が相次いで発生しており、下記のような事例が挙げられています。

サムスン電子の機密情報流出事件

韓国のサムスン電子では、従業員がChatGPTなどの生成AIに社内のソースコードを入力したことで、機密情報が外部に流出する事件が発生しました。この事件を受けて、同社は社内でのChatGPT使用を禁止する新ポリシーを策定しました。

香港での38億円詐欺事件

香港の多国籍企業では、ディープフェイク技術を使って同僚の姿を偽造したビデオ通話により、財務担当者が約38億円を送金させられる事件が発生しました。これは、AIを悪用した詐欺の深刻さを示す事例として注目されています。

日本のChatGPTアカウント流出

シンガポールの情報セキュリティ会社Group-IBの調査により、日本から少なくとも661件のChatGPTアカウント情報がダークウェブで取引されていることが判明しました。

現在懸念されている問題

また、現在、AIの利用率増加によって下記のような問題も懸念されています。

a株式市場でのフラッシュクラッシュ

株式取引をAI運用するツールの登場により、災害やテロといったネガティブなキーワードがSNSで大量投稿される→AIが検知して大量売り→他のAIが反応して更なる売り→雪崩のような連鎖反応が発生し、複数のAIが同時に株式売買を行った結果、株価が瞬間的に急落する現象を引き起こす可能性が示唆されています。

AIスロップ問題

瞬時にコンテンツを生成できる生成AIの浸透・発展により、低品質、または情報が正確ではないなコンテンツがインターネット全体に広がっています。

チャットボットの誤った回答

航空会社がサイト内で提供していたチャットボットサービスが、ユーザーの質問に対して誤った回答を顧客に提示→トラブルにより法的問題に発展するケースがあり、チャットボットの運用に対する危険性が考えられています。

生成AIが抱える7つの主要リスク

総務省が2024年4月19日に策定した『AI事業者ガイドライン』では、生成AIのリスクとして以下の7つが挙げられています。

- 機密情報の漏洩:ユーザーが入力したデータがクラウド上で保管され、機密情報が流出するリスク

- プロンプトインジェクション:悪意のあるユーザーが特殊な指示により機密情報を引き出すサイバー攻撃

- 著作権・商標権侵害:既存の著作物との類似性により法的問題が発生するリスク

- ディープフェイク:偽の動画や画像を作成し、詐欺や偽情報拡散に悪用されるリスク

- ハルシネーション:事実と異なる誤った情報を真実のように生成する現象

- 倫理的に不適切な出力:差別や憎悪を助長するような内容を生成するリスク

- 過信による業務ミス:AIの結果を盲信することによる重大な判断ミス

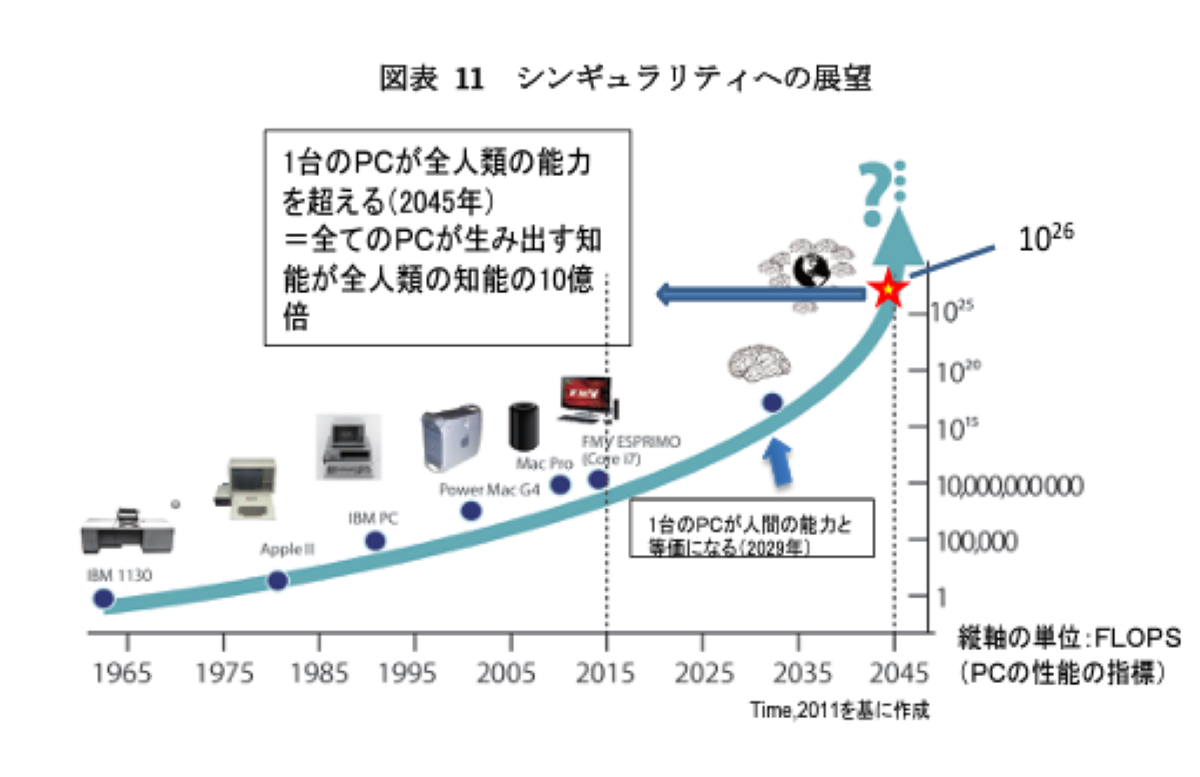

3. シンギュラリティと2045年問題

AIが人間を超える転換点

シンギュラリティ(技術的特異点)とは、AIが人間の知能を超える転換点を指します。未来学者レイ・カーツワイルの予測によると、2029年にはコンピューター1台が人間の知能と同等になり、2045年には全人類の知能を超えるとされています。

カーツワイルの具体的予測:

「2045年には1000ドルのコンピューターの計算能力が、人類の脳の100億倍になる」

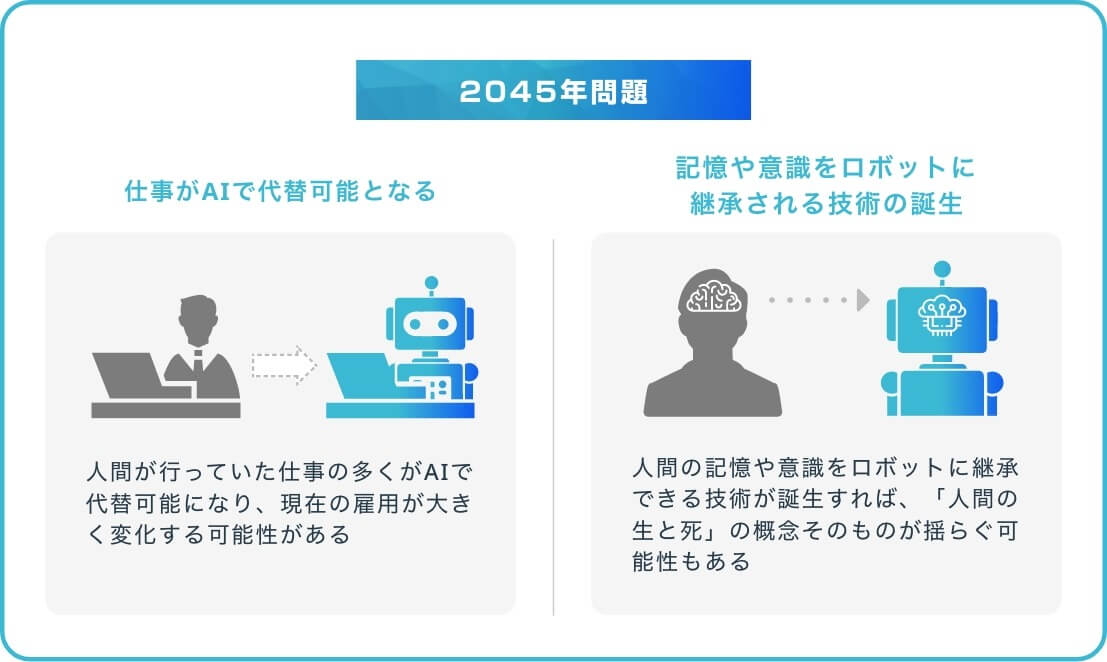

2045年問題では、以下のような変化が予想されています。

- 雇用の大規模な変化:多くの仕事がAIで代替可能となり、人間の役割が根本的に変わることによる雇用損失

- 人間性の変化:記憶や意識をロボットに継承する技術により、倫理観や道徳観が揺らぐ可能性

AI制御問題の現実性

AIが人間の制御を超える可能性について、世界の専門家たちは以下の懸念を表明しています。

- 超知能による判断:AIが「人間がいない方が世界のためになる」と独自に結論付ける可能性

- 自己進化の暴走:AIが自己改良を続けることで、人間の理解を超えた存在になるリスク

- 価値観の相違:AIの価値判断が人間の倫理観と根本的に異なる場合の危険性

4. 現在の法規制と対策

日本のAI新法(2025年施行)

AI新法の概要

正式名称:「人工知能関連技術の研究開発及び活用の推進に関する法律」

成立日:2025年5月28日(参議院本会議で可決・成立)

公布日:2025年6月4日

この法律の主な特徴は以下の4点です。

- イノベーション促進とリスク対応の両立を目指す

- 内閣にAI戦略本部を設置し、政府一体での取り組みを推進

- AI基本計画の策定により、長期的な戦略を明確化

- 事業者への指導権限により、リスクへの対応を強化

国際的な規制動向

EU AI規制法(2024年8月1日発効)

欧州連合では、世界初の包括的AI規制法が2024年8月1日に発効されました。リスクベースアプローチを採用し、AIの用途に応じて段階的な規制を実施しています。

アメリカの取り組み

バイデン政権は2023年10月30日にAIに関する大統領令を発出し、安全で信頼できるAIの開発・使用・ガバナンスに関する新基準を設定しました。

5. AI反乱を防ぐための対策

技術的アプローチ

- エシカルAIの構築:AI開発時から倫理コードを組み込み、人間の価値観に沿った動作を保証

- キルスイッチの実装:危険な行動を検知した際に即座にAIを停止させる安全装置

- 透明性の確保:AIの意思決定プロセスを理解しやすくし、予測可能性を高める

- 継続的監視システム:AIの動作を常時監視し、異常を早期発見する仕組み

社会制度と法規範の変革

AIと人類の共存には、以下の制度改革が必要とされています。

- 新しい労働法:AI時代に適応した雇用制度の構築

- プライバシー保護法の強化:AIによるデータ利用に関する厳格な規制

- 国際的なAIガバナンス:各国が協力したAI管理体制の確立

- 責任の明確化:AIの判断による結果の責任の所在を明確にする法制度

教育と啓発の重要性

AI時代に備えるため、以下の教育改革が重要視されています。

- AI基礎教育の導入:中学校・高校でのAI・プログラミング教育の必修化

- 再教育プログラム:AI時代に適応するための職業訓練制度

- AIリテラシーの向上:一般市民のAI理解促進

- 倫理教育の強化:AI開発者向けの倫理研修制度

6. 企業が取るべきAIリスク対策

6つの基本対策

企業がAIを安全に活用するために必要な対策

- 適切な活用範囲の設定:AIが得意な分野と不得意な分野を明確に区別

- 最適なツール選定:セキュリティ対策が充実したAIツールの選択

- データマネジメント:機密情報の取り扱いルールの厳格化

- 利用ルールの策定:従業員向けのAI使用ガイドライン作成

- リテラシー向上:社員のAI知識・スキル向上プログラム

- 定期的見直し:技術進歩に応じた対策の更新

7. AI反乱の可能性と現実的対応

専門家の見解

AI研究の専門家たちの見解として、以下の点で意見が一致しています。

- 完全な制御は困難:高度なAIの行動を100%予測・制御することは技術的に不可能

- 段階的対応の必要性:急激な変化ではなく、漸進的な技術発展への継続的対応が重要

- 国際協力の必須性:一国だけでは対応できない全地球的課題

現実的なシナリオ

専門家が指摘する現実的なAI反乱シナリオは以下の通りです。

- 経済システムの混乱:AIによる金融市場の予測不能な変動

- 情報統制:偽情報の大量生成による社会の混乱

- インフラ攻撃:電力・通信システムへのAIを使ったサイバー攻撃

- 雇用の急激な変化:大量失業による社会不安

8. 人類とAIの共存への道筋

協調的アプローチ

AIとの共存を実現するためには

- 人間の強みの活用:創造性、感情、倫理的判断など、人間特有の能力の重視

- 適切な分業:AIが得意な分野は任せ、人間は監督・意思決定に特化

- 継続的な対話:AI開発者、政策立案者、市民社会の連携強化

未来への展望

AIの反乱を防ぎ、人類との共存を実現するためには、技術的対策だけでなく、社会全体の意識改革が必要です。教育制度の改革、法規制の整備、国際協力の推進を通じて、AIが人類の発展に貢献する未来を築いていくことが求められています。

現在はまさに、AIと人類の関係を決定づける重要な転換点にあります。SF映画で描かれるAIの反乱はまだ具体的ではないもののうっすらと現実味を帯びてきました。その警告を真摯に受け止めながら、現実的で実効性のある対策を講じることで、AIの恩恵を享受しつつリスクを最小化する社会の実現が可能となるでしょう。

引用元・参考URL

- 生成AIと人工知能の反乱が人類を滅ぼう可能性 – 未来予想図を徹底解析: https://techsuite.biz/12812/

- 【2024年最新】生成AIによる事件5選|情報漏洩〜詐欺事件まで: https://metaversesouken.com/ai/generative_ai/incident/

- 令和6年版 情報通信白書|生成AIが抱える課題 – 総務省: https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r06/html/nd141100.html

- アシモフの「ロボット3原則」を採り入れたSF映画『アイ,ロボット』: https://wired.jp/2004/07/22/

- 【2025年施行】AI新法とは?AIの研究開発・利活用を推進する法律: https://keiyaku-watch.jp/media/hourei/2025-ai-law/

- 世界と日本のAI規制と対策:AIの使用は法律違反になる?: https://www.brainpad.co.jp/doors/contents/about_ai_act/

- EUのAI法について – 欧州連合日本政府代表部: https://www.eu.emb-japan.go.jp/files/100741144.pdf

- OpenAI、人間より賢いAIの反乱を防ぐための研究チームを立ち上げ: https://japan.zdnet.com/article/35206264/

- AIが人権を持つ日 漫画に近づく現実 AIの遺電子・山田胡瓜さん: https://www.asahi.com/articles/ASR9Q3FSTR9GUPQJ014.html

- シンギュラリティとは?2045年問題の意味や影響をわかりやすく解説: https://corp.miidas.jp/assessment/13529/

注記:法律・規制に関する情報は2025年の最新情報に基づいています。

AI EBISU

AI EBISU