重要な警告

最近、動画生成AI技術を悪用した詐欺が急増しています。特に警察官や検察官になりすましてビデオ通話で接触する手口が深刻化しており、若い世代も被害に遭っています。この記事で詐欺の手口を理解し、自分自身を守る知識を身につけましょう。

急増する動画生成AI詐欺の現状

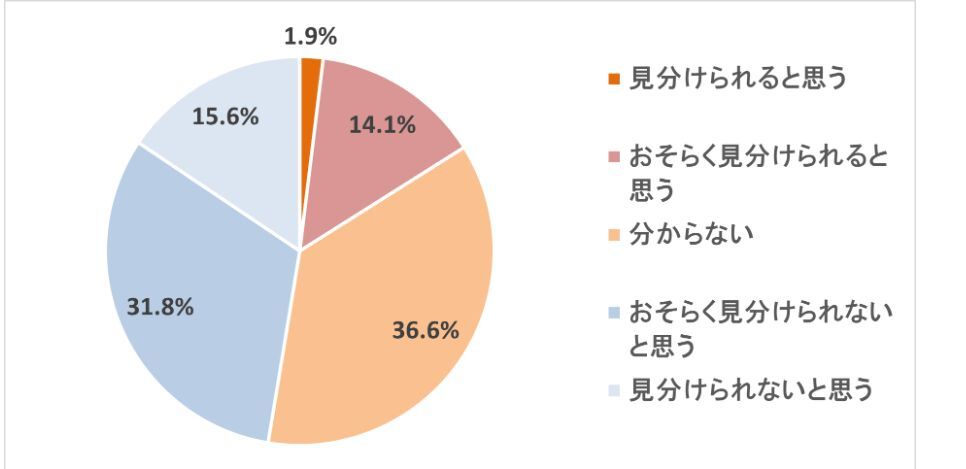

2024年の統計によると、特殊詐欺の被害額は過去最悪の721億5000万円に達しました。その中でも特に注目すべきは、動画生成AI技術を悪用した新しいタイプの詐欺です。

出典:ZDNET Japan – ディープフェイク被害調査

動画生成AIとディープフェイク技術

動画生成AIとは、人工知能を使って本物そっくりの動画や画像を作り出す技術です。この技術は「ディープフェイク」とも呼ばれ、本来は映画制作やエンターテインメント分野で活用される有益なものでした。

出典:Keeper Security – ディープフェイク解説

ディープフェイクの仕組み

顔の学習段階

AIが大量の写真や動画から顔の特徴を学習します。わずか数枚の写真からでも、その人の顔の特徴を覚えることができます。

顔の置き換え段階

リアルタイムで別人の顔に置き換えます。ビデオ通話中でも瞬時に顔を変えることが可能です。

表情の同期段階

元の人の表情や動きを合成された顔に反映させます。まばたきや口の動きも自然に再現されます。

ニセ警察官詐欺の具体的手口

出典:ALSOK – ディープフェイクなりすまし詐欺

第1段階:初期接触

詐欺グループは以下のような方法で被害者に接触します:

- 偽装電話番号:実在する警察署と同じ電話番号を表示(技術的に偽装可能)

- 不安をあおる内容:「あなたの口座が犯罪に使われています」

- アプリ誘導:「詳しい説明のため」としてLINEなどに誘導

第2段階:信頼の獲得

ビデオ通話で以下のような巧妙な偽装を行います:

偽の警察手帳提示

本物そっくりの警察手帳を画面に映し、信頼感を演出します。

制服着用

警察官の制服を着て、見た目から信じ込ませようとします。

AIで加工された顔

実在しない人物の顔を生成、または他人の顔を合成して正体を隠します。

偽の公文書

本物そっくりの逮捕状や令状を偽造して提示します。

第3段階:金銭要求

「捜査協力のため」「口座の安全確認のため」などの理由で以下を要求してきます:

- ネットバンキングでの送金指示

- 暗証番号やパスワードの聞き出し

- 複数回に分けた送金で被害額を拡大

被害の実態:数字で見る深刻さ

年代別被害状況(東京都の事例)

なぜ若い世代が狙われるのか?

デジタルネイティブ世代の特徴

若い世代が被害に遭いやすい理由として、以下の要因が挙げられます:

- ビデオ通話への慣れ:日常的にビデオ通話を使うため、警戒心が薄い

- デジタル決済への慣れ:スマホでの送金に抵抗感がない

- 自分は詐欺の対象外という思い込み:「詐欺は高齢者が狙われる」という先入観

- 技術への過信:「最新技術は安全」という誤った認識

AI詐欺を見破るためのチェックポイント

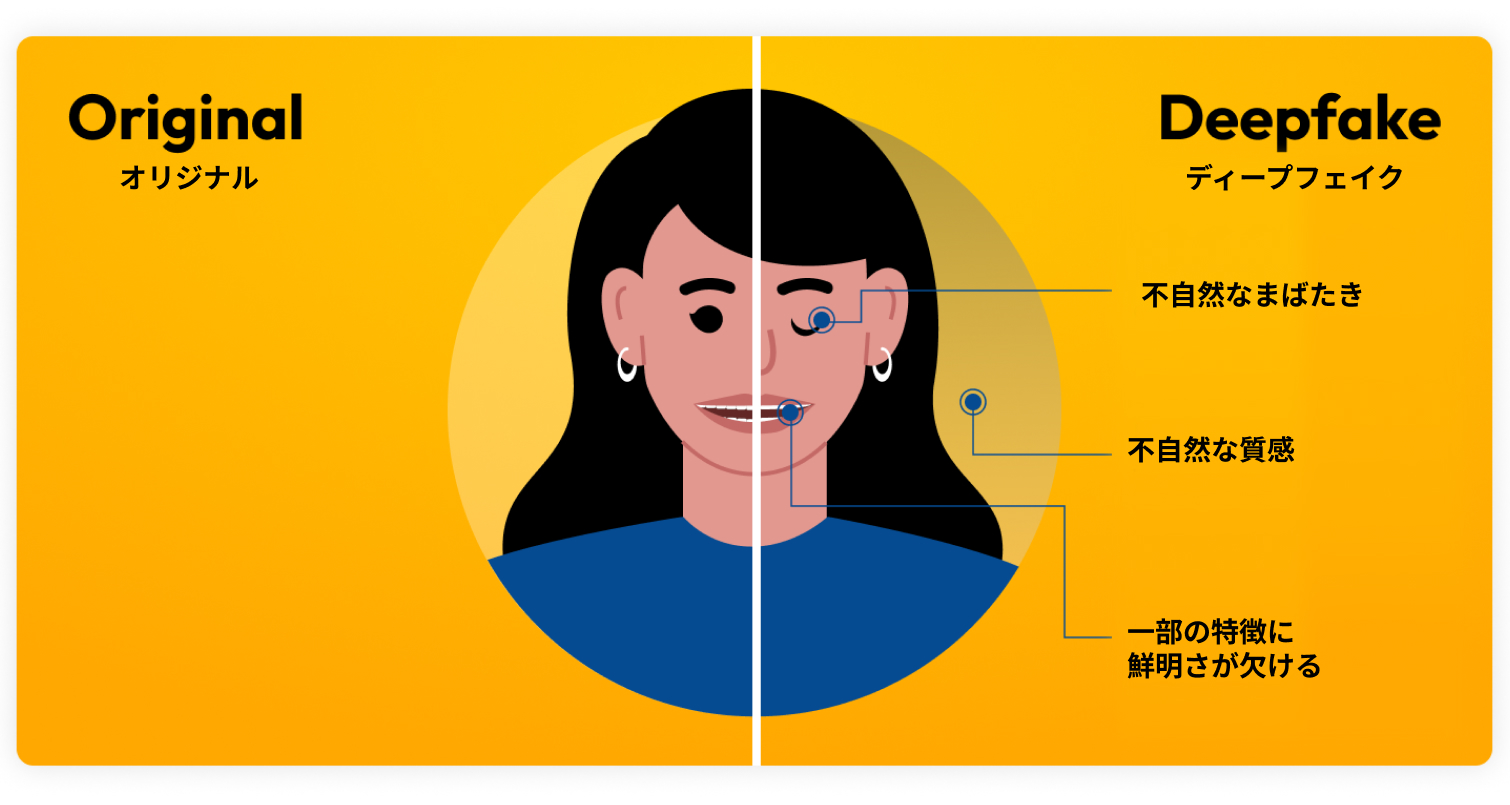

出典:NABLAS – ディープフェイク検知技術

視覚的な不自然さの確認

動画をよく観察して以下の点をチェック:

- まばたきの回数が異常に少ない、または多い

- まばたきのタイミングが機械的で不自然

- 顔の角度が変わると輪郭が歪む

- 髪の生え際が不自然に変化する

- 口の動きと音声がずれている

- 発音と口の形が一致しない

- 顔の影の方向が背景と合わない

- 照明の当たり方が不自然

音声の違和感チェック

- 抑揚の不自然さ:機械的な話し方

- 背景音の不一致:音声だけ別の場所で録音されたような違和感

- 息遣いの欠如:人間らしい自然な息遣いがない

確実な対策方法

基本的な対策

電話を一度切る

どんなに相手が急かしても、必ず一度電話を切りましょう。落ち着いて状況を整理する時間を作ることが重要です。

公式ルートでの確認

警察署の代表番号に直接電話をかけ直し、相手の名前、所属部署、内線番号を確認しましょう。

第三者への相談

家族や友人に必ず相談し、一人で判断せず複数の意見を聞くことが大切です。

技術的対策

活用できる技術的対策:

- 通話録画:可能な限り通話内容を録画・録音する

- 検出アプリの活用:ディープフェイク検出アプリを利用(完璧ではないことを理解)

- セキュリティソフト:最新のセキュリティソフトで詐欺サイトをブロック

警察の公式見解と注意喚起

警察が絶対にしないこと:

- 電話での捜査対象通知:警察官が電話で「あなたが捜査対象です」と伝えることはありません

- SNSでの連絡:LINEなどのSNSで警察が連絡することはありません

- 金銭の指示:警察が一般市民に送金を指示することはありません

- 資料の電子送信:警察手帳や逮捕状の画像を送ることはありません

もし接触された場合の対応

即座に電話を切る

相手の話を聞き続けず、まず電話を切ることが最優先です。

最寄りの警察署に相談

直接警察署に電話するか、110番通報で確認を取りましょう。

詐欺相談ダイヤルへの通報

♯9110(全国共通)で詐欺の相談ができます。

家族・知人への相談

一人で抱え込まず、信頼できる人に必ず相談しましょう。

被害に遭ってしまった場合の対処法

緊急対応

即座に行うべきこと:

- 送金の停止:銀行や送金サービスに即座に連絡

- 証拠の保全:通話記録、画面キャプチャの保存

- 警察への通報:最寄りの警察署への届出

- 口座の監視:不正使用がないか定期的にチェック

社会全体で取り組むべき対策

教育・啓発の重要性

- デジタルリテラシー教育:学校でのAI技術悪用に関する教育

- 世代を超えた情報共有:高齢者だけでなく若者も対象とした啓発

- 家族間での情報共有:詐欺手口の情報を家族で共有

技術的対策の推進

出典:NABLAS – ディープフェイク検知技術の進歩

- 検出技術の向上:AIによるディープフェイク検出技術の開発

- リアルタイム検出:ライブ通話中の即座の検出システム

- プラットフォーム対策:SNSやビデオ通話アプリでの詐欺対策強化

今後の展望と課題

技術進歩による影響

AI技術の進歩により、今後さらに巧妙な詐欺手口が現れることが予想されます。一方で、検出技術も同時に発達しており、技術と対策のいたちごっこが続くと考えられます。

法的整備の必要性

現在の法律では、AI技術を悪用した詐欺に対する対処が十分ではありません。今後は以下のような法的整備が必要です:

- AI悪用に特化した法律の制定

- 国際的な協力体制の構築

- 厳罰化による抑制効果の向上

まとめ:冷静な判断が重要

重要なポイント

動画生成AIを悪用した詐欺は、私たちの想像を超える速さで進化し、被害を拡大させています。特に警察官をかたる手口は、これまで詐欺とは無縁だと思われていた若い世代も巻き込み、深刻な社会問題となっています。

重要なのは、技術の進歩に対する正しい理解と適切な警戒心を持つことです。「自分は大丈夫」という思い込みを捨て、常に冷静な判断を心がけることが必要です。

また、一人で判断せず、必ず第三者に相談することが被害防止の鍵となります。家族や友人、そして警察という確実な相談先を活用し、詐欺グループの巧妙な手口に立ち向かっていきましょう。

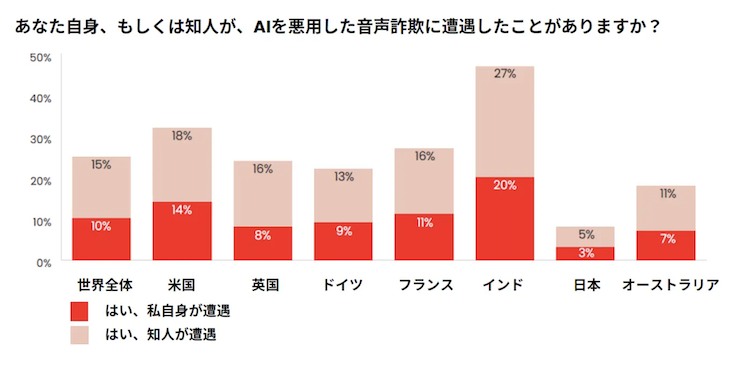

出典:Audiostart News – AI音声詐欺への注意喚起

最後に

技術の発達は私たちの生活を豊かにする一方で、悪用される危険性も併せ持っています。正しい知識と適切な対策により、安全で安心なデジタル社会の実現を目指していくことが、私たち一人ひとりに求められています。

少しでも怪しいと感じたら、迷わず警察や消費生活センターに相談してください。

参考文献・引用元

- 朝日新聞「警察官がたり」がオレオレ詐欺の8割以上 生成AIで再現し啓発

- NHK 急増!警察官などかたる詐欺 AIを悪用 映像を合成しビデオ通話

- 警察庁 特殊詐欺対策ページ

- ZDNET Japan ディープフェイク被害調査

- Keeper Security ディープフェイク解説

- NABLAS ディープフェイク検知技術

- ALSOK ディープフェイクの脅威

- Audiostart News AI音声詐欺への注意喚起

免責事項:本記事の情報は執筆時点のものであり、詐欺手口は日々進化しています。最新の情報については、警察庁や各都道府県警察の公式発表をご確認ください。

AI EBISU

AI EBISU