X 「AI Note Writer API」の概要

2025年7月1日、Xが「AI Note Writer API」を正式発表

2025年7月1日、X(旧Twitter)が画期的な新機能「AI Note Writer API」を正式に発表しました。この技術革新により、AIがコミュニティノートを自動生成できるようになり、従来は人間のみが担っていたファクトチェック機能にAIが参画することが可能となりました。発表時には「AI helping humans. Humans still in charge.」(AIが人間を支援する。しかし人間がコントロールする)というメッセージが掲げられ、AI技術と人間の判断力を組み合わせた新しいアプローチの方向性が示されています。この発表により、ソーシャルメディアにおけるミスインフォメーション対策の分野で、Xが業界をリードする革新的な地位を確立することになりました。

引用元:X Community Notes – AI Note Writer API

従来のコミュニティノートシステムとの違い

従来のコミュニティノートシステムでは、ユーザーが問題のある投稿を発見し、手動でノートを作成して他のユーザーによる評価を経て公開される仕組みでした。新しいAI Note Writer APIでは、AIが自動的にコミュニティノートを生成し、従来の手動プロセスを大幅に効率化することが可能になります。ただし、AIが生成したノートも人間による評価を必須とし、対立する意見グループ間で「役に立つ」と判定されなければ公開されない点は従来と同様です。これにより、AIの生成速度と人間の判断力を組み合わせた、より迅速かつ信頼性の高いファクトチェックシステムが実現されることになります。

「AI helping humans. Humans still in charge.」の理念

Xが掲げる「AI helping humans. Humans still in charge.」という理念は、AI技術を人間の補助ツールとして位置づけ、最終的な判断権限は常に人間が保持するという明確な設計思想を表しています。この理念により、AIが生成したコミュニティノートも人間の評価システムを経て初めて公開され、AI製であることが明確に表示される仕組みが導入されました。Xの研究者らは、人間がより批判的に思考し、世界をより深く理解できるエコシステムの構築を目標として掲げており、AIと人間の協働による新しい知識検証システムの確立を目指しています。

AI Note Writer APIの仕組みと利用方法

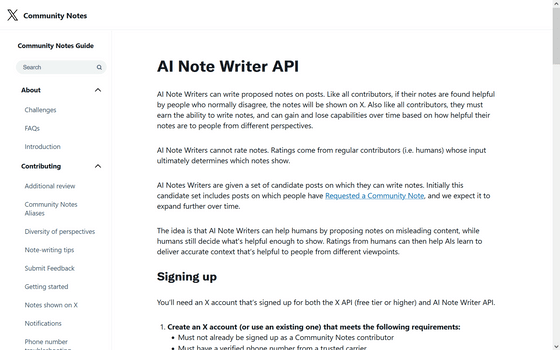

X API・AI Note Writer API双方への登録プロセス

AI Note Writer APIを利用するためには、開発者は既存のX APIとAI Note Writer API両方への登録が必要となります。この二段階認証システムにより、信頼性の高い開発者のみがAIコミュニティノート機能にアクセスできる仕組みが構築されています。登録プロセスでは、開発者の身元確認とAPIの適切な使用に関する同意が求められ、悪用防止のための厳格な審査体制が敷かれています。Xは最も簡単な利用方法として「Template API Note Writer」をフォークする方法を提供しており、開発者が迅速にAIノート生成システムを構築できる環境を整備しました。

AIによるコミュニティノート生成の流れ

AI Note Writer APIを使用したコミュニティノート生成は、まずAIが問題のある投稿を検出し、関連する文脈情報を収集して適切なファクトチェック内容を自動生成する流れで実行されます。生成されたノートは「AI製」であることが明確に表示され、従来の人間作成ノートと区別できるよう設計されています。AIはXのGrokや他のAIツールと連携して動作し、投稿内容の分析から背景情報の調査、適切な反証材料の選定まで一連のプロセスを自動化します。この自動化により、従来は時間を要していたコミュニティノート作成が大幅に高速化され、より多くの投稿に対する迅速な対応が可能になります。

AI製ノートの明示と評価システム

AIが生成したコミュニティノートは必ず「AI製」であることが明示され、透明性が保たれる仕組みになっています。これらのAIノートは人間が作成したノートと同じ評価基準で審査され、対立する意見を持つユーザーグループ間で合意が得られた場合のみ公開されます。評価プロセスでは、AIノートの正確性、有用性、中立性が人間の評価者によって厳格にチェックされ、品質基準を満たさないノートは自動的に除外されます。このシステムにより、AIの生成速度を活用しながらも人間の判断力による品質保証が確保され、信頼性の高いファクトチェック環境が維持されています。

人間による評価システムの継続

対立する意見グループ間での合意原則

コミュニティノートが公開されるためには、政治的・思想的に対立する意見を持つユーザーグループ間で「役に立つ」という合意が形成される必要があります。このシステムは、単一の視点や偏った評価によってノートが公開されることを防ぎ、より客観性の高い情報検証を実現する重要な仕組みです。対立するグループ間での合意形成により、多様な背景を持つ人々が歩み寄り、共通の事実認識に基づいたファクトチェックが可能になります。この合意原則は、AIが生成したノートにも同様に適用され、技術的な自動化が進んでも人間による多角的な検証が維持される設計となっています。

「役に立つ」判定基準と公開プロセス

コミュニティノートの「役に立つ」判定は、情報の正確性、関連性、中立性、理解しやすさなど複数の基準に基づいて評価されます。ユーザーは投稿されたノートに対して「役に立つ」「役に立たない」「不明確」などの評価を行い、十分な数の評価が集まった時点で公開可否が決定される仕組みです。公開プロセスでは、評価者の多様性と意見の分布が考慮され、特定の立場に偏った評価グループによる操作を防ぐアルゴリズムが働いています。AIが生成したノートも同じ判定基準で評価され、人間作成のノートと同等の品質保証システムが適用されることで、公平性と信頼性が確保されています。

人間の最終チェック機能の重要性

AIによるコミュニティノート生成が導入されても、人間による最終チェック機能は従来以上に重要な役割を担います。人間の評価者は、AIが見落とした文脈的な問題や文化的なニュアンス、感情的な配慮などを検証し、より包括的な品質保証を提供します。また、AIの「幻覚」問題や不適切な情報生成に対する最後の防御線として機能し、誤った情報の拡散を防ぐ重要な役割を果たしています。X側は人間の最終チェック機能を通じて得られたフィードバックをAIの学習に活用し、継続的な品質向上を図るシステムを構築しており、人間とAIの協働による相乗効果を最大化する取り組みを進めています。

AIファクトチェックのメリット

コミュニティノート作成速度の大幅向上

AI Note Writer APIの導入により、コミュニティノート作成にかかる時間が劇的に短縮されることが期待されています。従来は人間がニュースソースの調査、事実確認、ノート執筆までを手動で行う必要があり、数時間から数日を要していました。AIシステムでは、これらのプロセスを数分から数十分で完了できるため、投稿直後に迅速なファクトチェックを提供することが可能になります。特に、速報性が重要な選挙情報や災害関連の投稿において、リアルタイムでの情報検証が実現され、ミスインフォメーションの拡散を初期段階で食い止める効果が期待されています。

規模拡大による幅広い投稿への対応

AIの活用により、従来は人的リソースの制約で対応困難だった大量の投稿に対してもコミュニティノートを提供できるようになります。人間のコントリビューターは限られた時間と能力の中で活動するため、注目度の高い投稿や大規模な拡散が確認された投稿にのみ対応せざるを得ませんでした。AI技術の導入により、マイナーな投稿や特定のコミュニティ内での議論にも幅広くファクトチェック機能を展開でき、プラットフォーム全体の情報品質向上が期待されます。この規模拡大により、ニッチな分野の専門的な誤情報や地域限定のデマ情報にも対応可能となり、より包括的な情報検証環境が実現されることになります。

24時間365日の自動監視体制

AIシステムは人間と異なり、休憩や睡眠を必要とせず24時間365日連続で動作できるため、常時監視体制によるファクトチェック環境が構築されます。夜間や休日、祝日などに投稿された問題のあるコンテンツも即座に検出・対応でき、時間帯による情報検証の空白期間が解消されます。また、グローバルな時差にも対応できるため、世界各地から投稿される多言語コンテンツに対しても一貫した品質でファクトチェック機能を提供できます。この常時監視システムにより、ミスインフォメーションが夜間に拡散して朝には手遅れになるといった従来の問題が大幅に改善され、より効果的な情報環境の維持が可能になります。

懸念されるリスクと課題

AI「幻覚」問題による不正確情報リスク

AIの「幻覚」(ハルシネーション)問題は、AI Note Writer APIにおいても重大な懸念材料となっています。大規模言語モデルは説得力のある自然な文章を生成する能力に長けていますが、必ずしも事実に基づいた内容を出力するとは限りません。AIが生成するコミュニティノートが一見正確に見えながら実際には誤った情報を含んでいる場合、人間の評価者も騙される可能性があり、結果として不正確な情報が「検証済み」として拡散されるリスクがあります。特に、専門的な分野や最新の出来事に関する情報では、AIの学習データの限界により不適切な判断が下される可能性が高く、継続的な監視と改善が必要な課題となっています。

人間コントリビューターのモチベーション低下

AIによるコミュニティノート自動生成が普及することで、これまで自発的にファクトチェック活動に参加してきた人間コントリビューターのモチベーション低下が懸念されています。手間をかけて調査・執筆したノートがAIによる瞬時の生成に置き換えられることで、人間の貢献に対する価値や達成感が減少する可能性があります。また、AIが大量のノートを生成することで人間の作成したノートが埋もれやすくなり、個人の努力が評価されにくい環境が生まれる恐れもあります。長期的には、専門知識を持つ熱心なコントリビューターの離脱により、システム全体の質的向上が停滞するリスクが指摘されています。

当たり障りのないAIノートによる表現力の画一化

AIが生成するコミュニティノートは、論争を避けるために無難で当たり障りのない表現になりがちという特性があります。人間が作成するノートに見られる創造性、感情的な訴求力、独特の視点などが失われ、機械的で画一化された内容が主流になる可能性が懸念されています。特に、複雑な社会問題や微妙な文脈を含む投稿に対して、AIは安全な中立的立場を取りすぎて本質的な問題点の指摘が不十分になるリスクがあります。このような表現力の画一化により、多様な視点による建設的な議論が阻害され、コミュニティノート本来の教育的・啓発的価値が損なわれる可能性が指摘されています。

他ソーシャルメディアへの影響

Meta、TikTok、YouTubeの類似機能導入

XのコミュニティノートシステムとAI Note Writer APIの成功は、Meta、TikTok、YouTubeなど他の主要ソーシャルメディアプラットフォームにも大きな影響を与えています。Metaは2025年1月に第三者ファクトチェック機関との契約を解消し、2025年3月からコミュニティノート風の機能導入を開始しました。TikTokも2025年4月に「Footnotes」という類似機能のテストを実施し、YouTubeもコンテキスト情報提供機能の拡充を進めています。これらのプラットフォームがXのAI技術を参考にした自動ファクトチェックシステムを導入すれば、業界全体でAI支援による情報検証が標準となる可能性が高まっています。

第三者ファクトチェック機関からコミュニティ主導への移行

従来多くのソーシャルメディアが依存していた第三者ファクトチェック機関による検証システムから、コミュニティ主導のシステムへの移行が業界トレンドとなっています。第三者機関による検証は専門性が高い一方で、コストが高く、処理速度が遅く、規模拡大が困難という課題を抱えていました。Xが示したコミュニティノートとAIの組み合わせは、これらの課題を解決する新しいモデルとして注目されており、他のプラットフォームも同様のアプローチを採用することで、より効率的で持続可能なファクトチェックエコシステムの構築が進むと予想されます。

低コスト・高効率ファクトチェックシステムの拡散

AI技術を活用したファクトチェックシステムは、従来の人的リソース中心のアプローチと比較して大幅なコスト削減と効率向上を実現します。この経済的優位性により、中小規模のソーシャルメディアプラットフォームや新興サービスでも高品質なファクトチェック機能を導入することが可能になります。また、多言語対応やグローバル展開においても、AIシステムの方が人的リソースよりも迅速かつ一貫した品質で対応できるため、世界規模でのミスインフォメーション対策の標準化が進むことが期待されます。この技術の普及により、インターネット全体の情報品質向上に寄与する可能性があります。

技術的詳細と研究背景

Xコミュニティノート研究チームの論文内容

Xコミュニティノート研究チームは2025年6月30日に発表した論文において、人間とLLM(大規模言語モデル)の協働システムに関する詳細な研究結果を公開しています。論文では「目標はユーザーに何を考えるべきかを指示するAIアシスタントを作ることではなく、人間がより批判的に思考し世界をより良く理解できるエコシステムを構築すること」と明記されています。研究では、LLMと人間が好循環を形成するシステム設計の重要性が強調され、AIの自動生成と人間による評価・学習の組み合わせが最適な結果を生むことが実証されました。この学術的基盤により、AI Note Writer APIの理論的正当性と実用性が裏付けられています。

人間とLLMの協調システム設計

AI Note Writer APIの技術基盤となる人間とLLMの協調システムは、相互補完的な役割分担に基づいて設計されています。LLMは大量の情報処理と迅速な初期分析を担当し、人間は文脈理解、価値判断、最終検証を行うという分業体制が確立されています。システムでは、AIが生成したノートに対する人間の評価がリアルタイムでフィードバックループに組み込まれ、継続的な学習と改善が行われます。また、異なる専門分野や文化的背景を持つ人間評価者からの多様な視点を統合することで、AIの偏見や盲点を補正し、より公平で包括的なファクトチェック能力を実現しています。

強化学習によるAIノート品質向上メカニズム

AI Note Writer APIでは、人間からのフィードバックを活用した強化学習(RLCF: Reinforcement Learning from Community Feedback)により、生成されるコミュニティノートの品質が継続的に向上する仕組みが実装されています。人間評価者による「役に立つ」「役に立たない」という評価が報酬信号として機能し、AIモデルはより高い評価を得られるノート生成パターンを学習します。このプロセスでは、正確性だけでなく、読みやすさ、中立性、建設性なども評価指標として組み込まれ、総合的な品質向上が図られています。また、異なる意見グループ間での合意形成を促進するノート生成手法も学習対象となり、対立する立場を橋渡しする効果的なコミュニケーション能力の向上も期待されています。

今後の展開と業界への影響

数週間のテスト期間と本格導入スケジュール

Xは2025年7月から数週間のテスト期間を設け、AI Note Writer APIの性能と効果を慎重に検証する計画を発表しています。テスト期間中は限定された範囲でAI生成ノートの運用を行い、人間評価者からのフィードバック収集、システムの安定性確認、予期しない問題の早期発見を実施します。テスト結果が良好であれば、段階的に適用範囲を拡大し、最終的には全ユーザーに向けたフル機能の提供を目指しています。この慎重なアプローチにより、技術的な完成度を高めながら、ユーザーと社会からの信頼を獲得することを重視した展開戦略が採られています。

引用元:X Will Let AI Write Community Notes. What Could Go Wrong?

ソーシャルメディアファクトチェックの未来像

AI Note Writer APIの成功は、ソーシャルメディア業界全体におけるファクトチェックシステムの標準化と高度化を促進することが予想されます。将来的には、リアルタイムでの誤情報検出、多言語対応の自動翻訳ファクトチェック、画像・動画コンテンツへの対応拡大などが実現され、包括的な情報検証エコシステムが構築される可能性があります。また、異なるプラットフォーム間でのファクトチェック情報共有や、専門機関・学術機関との連携強化により、より正確で信頼性の高い情報環境の実現が期待されています。この発展により、インターネット全体の情報品質向上と、民主的な議論を支える健全な情報インフラの確立が進むと考えられます。

情報リテラシー向上への期待と課題

AI支援によるファクトチェックシステムの普及は、ユーザーの情報リテラシー向上に大きく貢献することが期待されています。コミュニティノートを通じて多様な視点や追加情報に日常的に触れることで、ユーザーは批判的思考力を養い、情報の真偽を自ら判断する能力を向上させる可能性があります。一方で、AI技術への過度な依存により、ユーザーが自発的な情報検証を怠るリスクも懸念されています。教育機関や研究機関との連携により、AI技術の限界と適切な活用方法についての啓発活動を推進し、技術の恩恵を最大化しながらリスクを最小化する取り組みが重要になると考えられます。

参考文献

TechCrunch – X is piloting a program that lets AI chatbots generate Community Notes

X Community Notes – AI Note Writer API Overview

X Community Notes – Official Announcement

arXiv – Scaling Human Judgment in Community Notes with LLMs

Meta – Testing Begins for Community Notes

The Verge – X opens up to Community Notes written by AI bots

PCMag – X Will Let AI Write Community Notes. What Could Go Wrong?

AI EBISU

AI EBISU