生成AI動画(ディープフェイク)の見分け方:私たちが知っておくべき危険と対策

ディープフェイクとは何か?

ディープフェイク(Deepfake)は、「ディープラーニング(深層学習)」と「フェイク(偽物)」を組み合わせた言葉です。AIの機械学習技術を使って、人物の顔や声を別の映像に合成し、実際には言っていない発言や行動をあたかも本物のように見せる技術のことを指します。

ディープフェイクの仕組み

データ収集

ある人物の顔写真や動画をAIに学習させます

特徴学習

AIがその人の表情や動きの特徴を詳細に分析・学習します

映像合成

学習した特徴を使って、別の人の顔と入れ替えたリアルな動画を生成します

現在生じているディープフェイクの深刻な問題

1. 経済犯罪における悪用

ディープフェイクを使った詐欺事件が世界中で多発しています。特に深刻なのは、企業の経営者や上司の声や顔を偽装した詐欺です。

実際の被害事例

イギリスのエネルギー企業事件(2019年)

- 親会社のCEOを装った偽の音声通話

- 被害額:22万ユーロ(約2,600万円)

- 被害者は声の調子や話し方が完全に一致していたため疑わなかった

香港の多国籍企業事件(2024年2月)

- ビデオ会議でCFO(最高財務責任者)を装った詐欺

- 被害額:約2億香港ドル(約37億円)

- 複数の同僚もビデオ会議に参加しているように見えたため信じてしまった

2. 政治・社会への影響

ディープフェイクは政治家や公人の発言を偽装し、選挙や世論に影響を与える危険性があります。偽の政治的発言や不適切な行動を描いた動画が拡散されることで、民主主義の根幹が脅かされる可能性があります。

3. 個人のプライバシー侵害

個人の写真や動画を悪用し、本人の同意なく不適切なコンテンツを作成する被害も深刻です。特に、リベンジポルノや嫌がらせ目的での悪用が社会問題となっています。

ディープフェイクによる被害の実態

トレンドマイクロが2024年に実施した「ディープフェイクに関する実態調査」によると、日本では以下のような深刻な実態が明らかになりました。

の人がディープフェイクの悪用に遭遇したことがあると回答

の人が実質的な被害を受けていると回答

の人が「ディープフェイクを見分けられる」以外の回答

被害の種類と傾向

| 年代 | 主な被害内容 | 特徴 |

|---|---|---|

| 若年層(10代~30代) | フェイクニュースやデマ情報による煽動 偽サイトへの誘導広告 |

不特定多数に向けたばらまき型 |

| シニア層(60代以上) | 投資詐欺への誘導 ロマンス詐欺での接触 |

特定のターゲットを狙った個別型 |

ディープフェイクの見分け方:具体的なチェックポイント

視覚的な確認方法

1. 表情と動作の不自然さをチェック

- 表情や動作が機械的に繰り返されていないか

- 顔の動きと体の動作が一致しているか

- 会話中の表情変化が乏しくなっていないか

2. 目と瞬きの観察

- 瞳が適切に動いているか

- 視線が不自然に固定されていないか

- まばたきのパターンが自然か

3. 光と影の整合性

- 影の付き方が光源の位置と一致しているか

- 顔と体の照明条件が同じか

- 肌の質感や髪の毛の動きが自然か

4. 音声の不一致

- 口の動きと発声のタイミングが合っているか

- 声の調子が一定過ぎないか

- バックグラウンドノイズ(車や風の音など)の一貫性

情報源の確認方法

複数ソースでの情報照合

- 同じ情報が複数の信頼できるニュースサイトで報じられているか

- 公式アカウントや認証済みメディアからの発信か

- 情報の発信日時と内容に矛盾がないか

逆画像検索の活用

- Google画像検索などで同じ映像や画像の出所を調べる

- 過去に別の文脈で使用された画像でないかを確認

注意すべき場面と対策

1. ビジネスシーンでの注意点

電話やビデオ会議での送金指示には特に注意

- 普段と異なる方法での連絡には疑いを持つ

- 重要な指示は必ず別の手段で確認を取る

- 社内で確認プロセスを明確に定める

会議の参加者確認

- ビデオ会議では参加者全員の身元を確認

- 画面共有や資料の内容に注意を払う

- 録画・録音機能を活用

2. 日常生活での注意点

SNSでの情報拡散前に確認

- 衝撃的な内容ほど慎重に検証する

- 情報の出所と日付を確認

- 怪しい情報は拡散しない

投資や恋愛関係の相談には特に慎重に

- 有名人や美男美女からの突然の連絡に注意

- 金銭を要求される場合は詐欺を疑う

- 家族や友人に相談してから行動

技術的な対策と検出ツール

最新の検出技術

現在、以下のように世界中でディープフェイク検出技術の開発が進んでいます。

東京大学の研究成果(2022年4月)

- ディープフェイク検出で世界最高級の性能を開発

- SBIsシステムによる高精度判定が可能

企業の取り組み

- Microsoft「Video Authenticator」

- トレンドマイクロ「ディープフェイクスキャン」(ベータ版、2024年9月リリース)

- Google、Meta等の検出技術開発

個人でできる対策

セキュリティソフトの活用

- ディープフェイク検出機能付きのセキュリティツール導入

- 定期的なソフトウェアアップデート

教育・学習の重要性

- Microsoft、ワシントン大学、USA Today、Sensityが共同開発した「Spot the Deepfake」等の学習コンテンツ活用

- 定期的な情報セキュリティ研修参加

組織での対策

- 従業員教育の徹底

- 確認プロセスの明文化

- 対策プランの策定

法的規制の現状と課題

国際的な規制動向

| 国・地域 | 施行時期 | 主な内容 |

|---|---|---|

| アメリカ | 2025年5月 | 性的ディープフェイクを含む性的画像・動画について、本人の同意無き公開を犯罪とみなす連邦法が成立 |

| カリフォルニア州 | 2024年 | ディープフェイク関連9法案が成立 選挙関連での悪用に刑事罰 |

| 韓国 | 2024年9月 | 性的ディープフェイクの所持・視聴に刑事罰を科す法案可決 |

| EU | 2024年8月 | AI規制法が発効、ディープフェイクも規制対象 |

日本の現状

現在、日本にはディープフェイク自体を直接規制する法律は存在しません。しかし、悪用された場合は以下の法律が適用される可能性があります。

- 名誉毀損罪:虚偽の事実を流布した場合

- 詐欺罪:金銭を騙し取った場合

- 著作権法:他人の肖像を無断使用した場合

- 不正アクセス禁止法:システムへの不正侵入

生成AI技術の正しい活用方法

残念ながらディープフェイク技術は悪用されている一方で、適切に使用すれば社会に大きな価値をもたらすことも事実です。

医療分野での活用

- 手術シミュレーションでの患者モデル作成

- 医学教育での症例再現

- リハビリテーション支援

教育分野での活用

- 歴史上の人物との対話体験

- 語学学習でのネイティブ会話練習

- 遺跡や文化財の仮想復元

エンターテイメント分野

- 映画・ドラマの特殊効果

- バーチャルアイドルの表現向上

- ゲームでのリアルなキャラクター表現

今後私たちが取るべき行動

個人レベルでの対応

1. 継続的な学習

- 最新のディープフェイク技術動向を把握

- セキュリティ意識の向上

- 批判的思考力の育成

2. 情報の取り扱いへの注意

- 個人情報の公開範囲を制限

- SNSでの写真・動画投稿時の注意

- プライバシー情報の適切な管理

3. 社会的責任の自覚

- 未確認情報の拡散を避ける

- ファクトチェックの習慣化

- 周囲への啓発

組織・企業レベルでの対応

セキュリティ体制の構築

- ディープフェイク対策の組織的推進

- 従業員教育プログラムの実施

- インシデント対応体制の整備

技術的対策の導入

- 検出ツールの導入検討

- システムセキュリティの強化

- 定期的なセキュリティ監査

社会的責任の履行

- 適切な技術活用の推進

- 業界全体での取り組み参加

- 規制策定への協力

まとめ:デジタル時代を安全に生きるために

ディープフェイク技術は、私たちの社会に大きな変化をもたらしています。便利な面もある一方で、悪用された場合の被害は甚大です。重要なのは、この技術の存在を正しく理解し、適切な対策を講じることです。

技術の進歩は止まることがありません。私たち一人ひとりが情報リテラシーを向上させ、批判的思考を持って情報に接することが、デジタル時代を安全に生きるための鍵となります。

また、個人の努力だけでなく、企業や政府レベルでの対策も不可欠です。技術的な解決策の開発、法的規制の整備、そして社会全体での意識向上が相互に作用することで、ディープフェイクの脅威を最小限に抑えることができるでしょう。

私たちは今、新しい技術と共存する方法を学ぶ重要な時期にいます。正しい知識と適切な対策により、ディープフェイク技術の恩恵を受けながら、その危険性から身を守ることが可能です。

引用元・参考文献

- 1. ディープフェイクとは?危険性や被害事例、見分け方を解説 – LANSCOPE

- 2. 「ディープフェイクに関する実態調査2024年版」から見えてきた脅威を解説 – トレンドマイクロ

- 3. 【ディープフェイクとは】3つの見分け方と有効的な活用例を紹介 – マイナビ

- 4. ディープフェイクに関する国内実態調査2024 – トレンドマイクロ

- 5. AIが生成したフェイク顔映像の真贋を自動判定する – 科学技術振興機構

- 6. 性的ディープフェイク 被害者泣き寝入りも 直接規制なき日本 – 毎日新聞

- 7. 米カリフォルニア州知事、ディープフェイク関連の9つのAI法案に署名 – JETRO

- 8. ディープフェイクの検出で世界最高性能を達成 – 東京大学

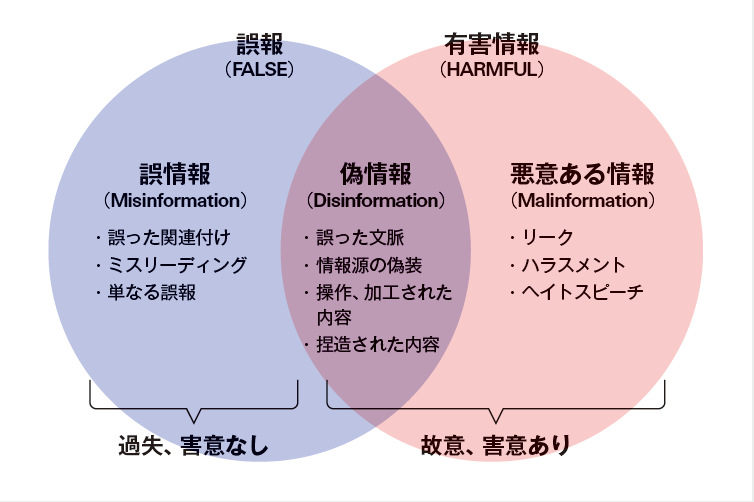

- 9. 偽・誤情報の流通・拡散等の課題及び対策 – 総務省

- 10. 企業を守るAIフェイク検知 – NABLAS株式会社

- 11. Windows PC向けディープフェイク検出ツール(ベータ版)の提供を開始 – トレンドマイクロ

- 12. 米 本人同意ない性的画像などの投稿 犯罪とする初の連邦法成立 – NHK

最終更新:2025年6月24日

AI EBISU

AI EBISU